作者:老余捞鱼

原创不易,转载请标明出处及原作者。

写在前面的话:最近我团队里喜欢搞AI的小伙子折腾出一个新玩法,用深度强化学习来搞纳斯达克ETF配置。但这不是什么玄乎的独门秘籍,而是正经的算法工程。今天就用大白话给大家拆解一下这玩意儿到底靠不靠谱,希望您对有所启发。

一、从”躺平”到”动脑”:ETF配置的新思路

过去几年,身边不少朋友都喜欢搞”被动配置”:找个跟踪纳斯达克100的ETF,比如QQQ,然后长期持有。这种思路没错,毕竟纳斯达克100代表了美科技股的核心资产,长期向上的趋势比较明显。

但问题也来了:市场不是直线运动的。2020年的熔断、2022年的加息风暴、2024年的AI狂潮,这些大波动让不少”躺平派”坐了一轮又一轮的过山车。有些人能扛住,有些人却在最低点因恐慌而离场,错过了后面的修复。

这就引出了一个核心矛盾:我们既想享受科技成长的红利,又不想承受过大的波动伤害。传统的解决方案是定期再平衡,比如股债60/40配置,每季度调整一次。但这种静态规则有个毛病——它不看市场环境,到点就调,有时候反而适得其反。

于是,有人开始琢磨:能不能让算法像人一样”看情况办事”?市场平静时激进一点,市场动荡时保守一点,而且这个过程是自动的、数据驱动的。这就是今天我要聊的深度强化学习(Deep Reinforcement Learning, DRL)在ETF配置中的应用。

二、3个ETF的性格画像

在聊技术之前,得先认识一下这个策略里的三位主角。研究者选了三只纳斯达克100的衍生ETF,它们就像三个性格迥异的投资顾问:

1. TQQQ:激进的增长追求者

TQQQ是ProShares发行的三倍敞口ETF。简单说,如果纳斯达克100当天涨1%,TQQQ理论上涨3%;但如果跌1%,它也跌3%。这种”倍数敞口”的特性让它在牛市中表现极为亮眼,但波动也成倍放大。

这位”顾问”的建议通常是:“冲啊,别怂!”适合用在趋势明确、市场情绪高涨的阶段,但在震荡市或下行期,它会让人睡不好觉。

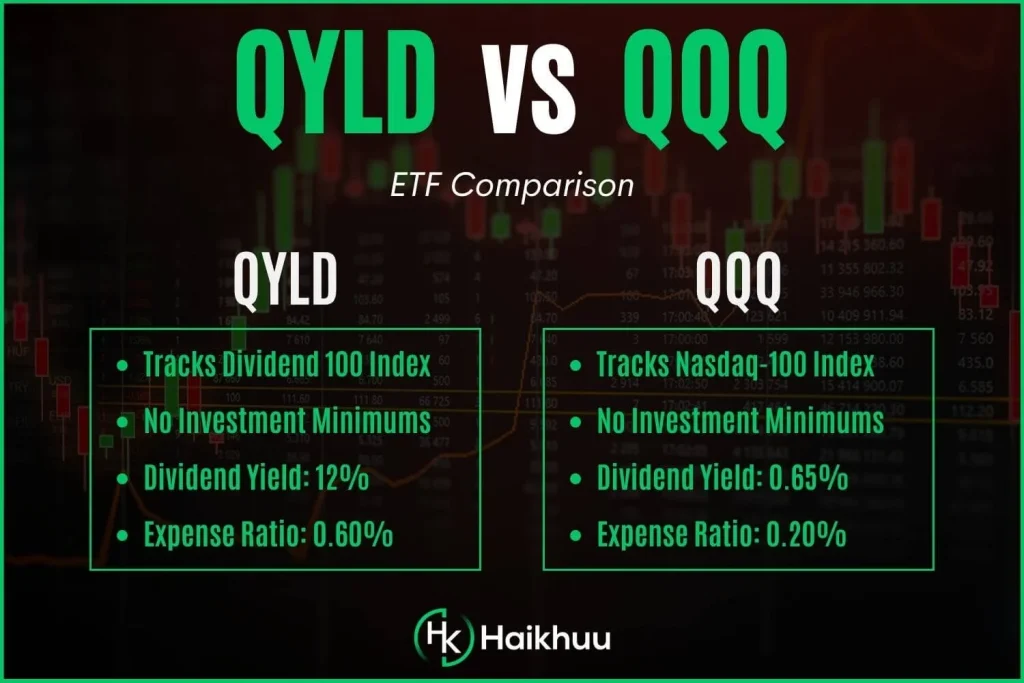

2. QYLD:保守的收益收集者

QYLD的策略是持有纳斯达克100成分股的同时,卖出看涨期权来收权利金。这就像是把股票租出去收租金,代价是如果股价大涨,超额收益要归租客(期权买方)所有。

QYLD这位”顾问”的关键词是“稳”。它每月分红,波动相对较小,但在大牛市中会跑输指数。适合用在市场方向不明、需要现金流的阶段。

3. YQQQ:谨慎的逆向思考者

YQQQ是2024年才推出的新品种,它通过期权策略提供逆向敞口,同时持有美债收利息。简单来说,当市场下跌时它可能获益,市场上涨时它也能收点固定收益。

这位”顾问”的角色是“保险”。平时可能显得多余,甚至拖后腿,但在黑天鹅事件、市场恐慌时,它能起到对冲效果,降低整体组合的回撤幅度。

| ETF代码 | 核心策略 | 适用场景 | 主要风险 |

|---|---|---|---|

| TQQQ | 3倍杠杆做多 | 牛市追涨 | 杠杆损耗、大幅回撤 |

| QYLD | 备兑看涨期权 | 横盘市场、追求现金流 | 牺牲上涨潜力 |

| YQQQ | 反向敞口+期权 | 市场调整期对冲 | 牛市表现不佳 |

黄金三角组合逻辑:这三只ETF构成了一个互补系统:TQQQ负责进攻,QYLD提供稳定现金流和基础配置,YQQQ作为防御盾牌。关键在于:什么时候让谁多出力?这就是AI要解决的核心问题。

三、AI大脑是怎么工作的?

现在来到技术环节。别被”深度强化学习”这个词吓到,其实原理并不复杂,我尽量用大家都能听懂的话来解释。

1. 目标函数:算法的”价值观”

研究者给AI设定了一个目标函数(Utility Function),这就像是告诉它:“你要在追求超额收益和控制跟踪误差之间找到平衡。”

U(w) = (1-λ) × ER(w) – λ × TE(w)

这里的ER(w)是超额收益(跑赢了QQQ多少),TE(w)是跟踪误差(偏离QQQ的程度),λ是一个调节参数。

- λ越小,AI越激进,追求超额收益;

- λ越大,AI越保守,紧紧跟着 benchmark 走。

有趣的是,这个λ不是固定的。研究者让它根据市场环境动态调整——就像人类配置者在牛市中越来越大胆,在熊市中越来越谨慎一样。

2. PPO算法:AI的”学习方法”

这套系统用的是近端策略优化(Proximal Policy Optimization, PPO)算法。你可以把它想象成一个不断试错的学生:

| 步骤 | AI的行为 | 类比人类投资 |

|---|---|---|

| 观察状态 | 读取ETF价格、波动率、异常信号 | 看盘、读新闻、感知市场情绪 |

| 采取行动 | 决定三只ETF的配置比例 | 决定加点哪个、减点哪个 |

| 获得奖励 | 根据收益和风险调整获得评分 | 赚钱了就开心,亏多了就反思 |

| 更新策略 | 调整神经网络权重,优化下次决策 | 总结经验教训,下次改进 |

3. 辅助决策系统:VAR和异常检测

AI还有两个”外脑”帮忙:

向量自回归(VAR):这是一个统计模型,用来分析三只ETF之间的相互影响。比如今天TQQQ大涨,可能会影响明天QYLD的期权定价,VAR能捕捉这种连锁反应。

孤立森林(Isolation Forest):这是一个异常检测算法,用来识别”不正常”的市场行为。比如突然出现的流动性枯竭、波动性飙升。一旦检测到异常,系统会提前触发再平衡,而不是等到固定周期。

四、实战:理想与现实的差距

说了这么多理论,大家最关心的一定是:这玩意儿到底挣不挣钱?我们来看数据。

把2010年到2025年的数据分成三段:

2010-2018年训练,2019-2023年验证,2024-2025年测试。

这就像是:先学课本(训练),再模拟考试(验证),最后真刀真枪上考场(测试)。

阶段一:训练期(2010-2018)学霸模式

| 指标 | DRL组合 | QQQ基准 | 差异 |

|---|---|---|---|

| 超额收益 | +30.96% | 0% | 显著领先 |

| 夏普比率 | 2.34 | 0.88 | 风险调整后收益更优 |

| 索提诺比率 | 2.40 | 0.92 | 下行风险控制优秀 |

| 跟踪误差 | 12.62% | – | 偏离度可控 |

这个阶段AI表现优异,几乎碾压基准。但这是预期的:毕竟它就是看着这些数据”学习”的,就像考试前看过答案的学生。

阶段二:验证期(2019-2023) 现实打击

| 指标 | DRL组合 | QQQ基准 | 表现评价 |

|---|---|---|---|

| 超额收益 | +7.6% | 0% | 仍有超额,但大幅回落 |

| 夏普比率 | 0.80 | 0.70 | 优势缩小 |

| 跟踪误差 | ~20% | – | 偏离度明显上升 |

这个阶段经历了新冠疫情、加息周期、AI热潮等剧烈波动。AI的表现虽然还是正的,但明显吃力了。特别是2022年的科技股大跌,让依赖历史数据的模型措手不及。

阶段三:测试期(2024-2025) 滑铁卢

| 指标 | DRL组合 | QQQ基准 | 结果 |

|---|---|---|---|

| 超额收益 | +3.25% | 0% | 勉强为正 |

| 夏普比率 | 0.55 | 0.70 | 低于基准 |

| CVaR (95%) | 5.05% | 3.34% | 尾部风险更高 |

残酷真相:在完全陌生的数据上,AI虽然还能创造一点点超额收益,但风险调整后的收益已经跑输基准。这就是典型的过拟合现象:模型太”记住”过去,反而适应不了未来。

配置行为的演变

有趣的是,观察AI的配置行为变化,你会发现它越来越像一个谨慎的基金经理:

- 训练期:偏好QYLD(约40%),喜欢稳定的现金流。

- 验证期:转向TQQQ(约42%),抓住疫情后的牛市。

- 测试期:频繁调整,增加YQQQ作为对冲,表现出防御姿态。

在某些时刻,AI甚至会把70%的资金押注在单只ETF上,显示出”孤注一掷”的倾向。这种行为在人类看来是勇敢,但在统计学上叫风险集中。

五、复盘:为什么越往后表现越差?

作为量化研究者,看到这种”前高后低”的曲线,我的第一反应不是”这模型废了”,而是思考:我们可以从中学到什么?

1. 市场制度的变迁

2010年代的低利率环境、量化宽松政策,塑造了特定的市场模式。AI从这些数据中学到的”规律”,在2020年代的加息周期、地缘政治冲突、AI技术革命中根本不适用。市场不是静止的池塘,而是流动的河流。

2. 静态训练的局限

这个模型是一次性训练完就”定型”了,就像一位老中医只学过古代医书,遇到新冠这种新病毒就麻爪。更好的做法应该是滚动学习:让AI持续吸收新数据,不断调整认知。

3. 特征维度的缺失

模型主要用的是价格数据,没充分考虑宏观经济指标(通胀率、利率决议)、市场情绪(VIX恐慌指数)、资金流向等维度。这就像开车只看后视镜,不看前方路况。

4. 交易成本的遗漏

研究中似乎没有充分考虑滑点和交易费用。实际应用中,频繁的再平衡会产生显著的成本侵蚀,特别是对日内波动敏感的ETF如TQQQ。

我的提醒:看任何量化策略的回测,都要问三个问题:是否考虑了流动性冲击?是否包含了交易成本?是否在样本外验证过?如果这三个问题有一个回答不上来,那就要打问号。

六、给大家的三个启示

虽然这个AI策略在实测中表现一般,但它给我们的启发比结果更有价值。

启示一:动态比静态好,但动态也有代价

完全”躺平”配置确实简单,但会经历不必要的回撤。适度的人工干预或规则化调整(比如波动率目标策略)可能是更好的折中。关键是找到调整频率和交易成本的平衡点。

启示二:不要把鸡蛋放在一个篮子里,也不要频繁换篮子

AI在测试期有时候把70%资金集中在单只ETF上,这种行为很危险。对普通配置者来说,单品种暴露不宜超过30%是铁律。同时,过于频繁的调仓会增加不确定性,季度或半年度审视一次组合可能更合适。

启示三:敬畏”过拟合”,警惕”完美曲线”

如果你看到某个策略的历史回测曲线特别漂亮,比如几乎直线向上,那要小心了,太好的历史表现往往意味着对未来的透支。真正稳健的策略,回测曲线应该是”锯齿状向上”,有回撤、有修复,而不是一路开挂。

七、展望与总结

尽管这个特定的研究有局限性,但它代表了未来的方向。深度强化学习在资产配置中的应用是不可逆转的趋势。

我设想中的理想模式是:

- AI负责:实时监控、数据处理、信号生成、风险预算计算。

- 人类负责:宏观判断、极端情况干预、参数设置、伦理审查。

比如,当AI建议”当前应将TQQQ配置提升至50%”时,人类基金经理应该追问:”为什么?是基于什么市场特征做出的判断?是否考虑了美联储下周的议息会议?”这种可解释性的要求,会倒逼AI技术向更透明、更稳健的方向发展。

另外,随着迁移学习和在线学习技术的成熟,未来的模型将能够更快地适应新环境,而不是像现在这样”一招鲜吃遍天”然后撞墙。

老余总结:理性看待AI配置工具

这项研究证明了深度强化学习在ETF配置中的理论可行性,也暴露了其在实际应用中的脆弱性。AI可以是一个强大的辅助工具,但绝不是万能钥匙。

核心要点:

- 深度强化学习能够实现动态资产配置,但需警惕过拟合风险。

- TQQQ/QYLD/YQQQ的组合提供了进攻、稳健、防御的三角平衡。

- 滚动训练和样本外验证是评估策略稳健性的金标准。

- 任何模型都无法预测黑天鹅,人类监督仍是必需。

- 成本控制和风险分散比追求超额收益更重要。

八、实践代码

考虑到大多数读者没有复杂的多GPU集群,所以接下来我用Python构建一个简化版本,手把手教大家构建简化版DRL投资组合。

第一步:环境准备

# 安装必要的库# !pip install yfinance numpy pandas matplotlib scikit-learn stable-baselines3 gymimport yfinance as yfimport numpy as npimport pandas as pdimport matplotlib.pyplot as pltfrom sklearn.preprocessing import StandardScalerimport gymfrom gym import spacesfrom stable_baselines3 import PPOfrom stable_baselines3.common.vec_env import DummyVecEnv第二步:数据获取

defget_etf_data(tickers, start_date, end_date):""" 获取ETF历史数据 参数: tickers: ETF代码列表 start_date: 开始日期 end_date: 结束日期 返回: pandas DataFrame: 包含各ETF调整后收盘价的数据框 """ data = {}for ticker in tickers: df = yf.download(ticker, start=start_date, end=end_date) data[ticker] = df['Adj Close']return pd.DataFrame(data)# 获取三只ETF的数据tickers = ['TQQQ', 'QYLD', 'QQQ'] # 我们用QQQ作为基准start_date = '2020-01-01'end_date = '2024-12-31'# 获取价格数据price_data = get_etf_data(tickers, start_date, end_date)print("数据获取完成!")print(f"数据形状: {price_data.shape}")print("\n前5行数据:")print(price_data.head())第三步:计算收益率和特征

# 计算日收益率returns = price_data.pct_change().dropna()# 计算波动率(20日滚动标准差)volatility = returns.rolling(window=20).std()# 合并特征features = pd.concat([returns, volatility], axis=1)# 重命名列名以区分收益和波动率特征return_columns = [f'{col}_return'for col in returns.columns]volatility_columns = [f'{col}_vol'for col in volatility.columns]features.columns = return_columns + volatility_columns# 删除缺失值features = features.dropna()print("特征工程完成!")print(f"特征数据形状: {features.shape}")print(f"特征列名: {list(features.columns)}")print("\n前5行特征数据:")print(features.head())第四步:构建强化学习环境

classETFPortfolioEnv(gym.Env):""" ETF投资组合环境 这是一个自定义的OpenAI Gym环境,用于模拟ETF投资组合管理问题。 智能体学习如何分配两只ETF的权重以最大化超额收益并控制追踪误差。 """def__init__(self, features, returns, benchmark_returns, lambda_param=0.25):""" 初始化环境 参数: features: 特征数据(状态) returns: ETF收益率数据 benchmark_returns: 基准收益率数据(QQQ) lambda_param: 风险厌恶系数,控制追踪误差的惩罚程度 """super(ETFPortfolioEnv, self).__init__()# 数据初始化self.features = features.valuesself.returns = returns[['TQQQ', 'QYLD']].values # 只用两只ETF简化self.benchmark_returns = benchmark_returns.valuesself.lambda_param = lambda_param# 环境状态self.current_step = 0self.max_steps = len(self.features) - 1# 动作空间: 两只ETF的权重(0到1之间,会自动归一化)self.action_space = spaces.Box( low=0, high=1, shape=(2,), dtype=np.float32 )# 状态空间: 所有特征self.observation_space = spaces.Box( low=-np.inf, high=np.inf, shape=(self.features.shape[1],), dtype=np.float32 )defreset(self):""" 重置环境到初始状态 返回: 初始状态的特征向量 """self.current_step = 0returnself.features[self.current_step]defstep(self, action):""" 执行一步动作 参数: action: ETF权重数组 [weight_TQQQ, weight_QYLD] 返回: next_state: 下一个状态 reward: 奖励值 done: 是否结束 info: 附加信息 """# 归一化权重以确保总和为1 weights = action / action.sum()# 计算投资组合收益 portfolio_return = np.dot(weights, self.returns[self.current_step])# 计算超额收益 excess_return = portfolio_return - self.benchmark_returns[self.current_step]# 计算追踪误差(简化版: 用收益差的绝对值) tracking_error = abs(portfolio_return - self.benchmark_returns[self.current_step])# 计算奖励(效用函数) reward = excess_return - self.lambda_param * tracking_error# 移动到下一步self.current_step += 1 done = self.current_step >= self.max_steps# 获取下一个状态ifnot done: next_state = self.features[self.current_step]else:# 如果已经结束,返回当前状态 next_state = self.features[self.current_step - 1]return next_state, reward, done, {}defrender(self, mode='human'):"""渲染环境状态(当前为空实现)"""passprint("环境构建完成!")第五步:训练PPO智能体

# 创建环境实例env = ETFPortfolioEnv( features=features, returns=returns, benchmark_returns=returns['QQQ'], lambda_param=0.25)# 包装环境以支持向量化(兼容stable-baselines3)env = DummyVecEnv([lambda: env])# 创建PPO模型model = PPO("MlpPolicy", # 使用多层感知机策略网络env, # 训练环境 verbose=1, # 输出训练日志 learning_rate=0.0003, # 学习率 n_steps=2048, # 每次更新前收集的步数 batch_size=64, # 小批量大小 n_epochs=10, # 每次更新时的优化轮数 gamma=0.99, # 折扣因子 gae_lambda=0.95, # GAE参数 clip_range=0.2, # PPO剪裁范围 ent_coef=0.01 # 熵系数(鼓励探索))print("开始训练PPO模型...")print("-" * 50)# 训练模型(这里用较少的步数演示,实际应用需要更多步数)training_steps = 50000model.learn(total_timesteps=training_steps)print("-" * 50)print("训练完成!")print(f"总训练步数: {training_steps}")# 保存模型model.save("etf_portfolio_ppo")print("模型已保存到: etf_portfolio_ppo.zip")print("注意: 保存的模型文件包括策略网络参数和环境配置")第六步:回测和可视化

# 加载训练好的模型model = PPO.load("etf_portfolio_ppo")print("模型加载成功!")# 创建回测环境env = ETFPortfolioEnv( features=features, returns=returns, benchmark_returns=returns['QQQ'], lambda_param=0.25)# 重置环境obs = env.reset()# 初始化累计价值(起始为1,表示100%)portfolio_values = [1.0] # DRL投资组合累计价值benchmark_values = [1.0] # 基准(QQQ)累计价值# 执行回测print("开始回测...")for i inrange(len(features) - 1):# 使用模型预测动作 action, _states = model.predict(obs, deterministic=True)# 执行动作并获取新状态 obs, reward, done, info = env.step(action)# 计算投资组合收益和累计价值 weights = action / action.sum() portfolio_return = np.dot(weights, env.returns[env.current_step - 1]) portfolio_values.append(portfolio_values[-1] * (1 + portfolio_return))# 计算基准收益和累计价值 benchmark_return = env.benchmark_returns[env.current_step - 1] benchmark_values.append(benchmark_values[-1] * (1 + benchmark_return))if done:breakprint(f"回测完成,共{len(portfolio_values)}个交易日")# 可视化回测结果plt.figure(figsize=(14, 7))plt.plot(portfolio_values, label='DRL投资组合', linewidth=2.5, color='#FF6B6B') plt.plot(benchmark_values, label='QQQ基准', linewidth=2, linestyle='--', color='#4ECDC4', alpha=0.8)# 图表美化plt.title('DRL投资组合 vs QQQ基准 - 累计收益对比', fontsize=16, fontweight='bold', pad=20)plt.xlabel('交易日', fontsize=12)plt.ylabel('累计收益 (倍数)', fontsize=12)plt.legend(fontsize=11, loc='upper left', frameon=True)plt.grid(True, alpha=0.3, linestyle='--')plt.tight_layout()# 保存图表plt.savefig('portfolio_performance.png', dpi=300, bbox_inches='tight')plt.show()print("图表已保存为 'portfolio_performance.png'")# 计算关键性能指标print("\n" + "="*50)print("回测绩效分析")print("="*50)# 计算日收益率序列portfolio_daily_returns = np.diff(portfolio_values) / portfolio_values[:-1]benchmark_daily_returns = np.diff(benchmark_values) / benchmark_values[:-1]# 总收益portfolio_total_return = (portfolio_values[-1] - 1) * 100benchmark_total_return = (benchmark_values[-1] - 1) * 100excess_return = portfolio_total_return - benchmark_total_return# 年化收益率portfolio_annual_return = ((1 + portfolio_total_return/100) ** (252/len(portfolio_daily_returns)) - 1) * 100benchmark_annual_return = ((1 + benchmark_total_return/100) ** (252/len(benchmark_daily_returns)) - 1) * 100# 夏普比率(年化)portfolio_sharpe = (np.mean(portfolio_daily_returns) / np.std(portfolio_daily_returns)) * np.sqrt(252)benchmark_sharpe = (np.mean(benchmark_daily_returns) / np.std(benchmark_daily_returns)) * np.sqrt(252)# 最大回撤defcalculate_max_drawdown(values):"""计算最大回撤""" cumulative = np.array(values) running_max = np.maximum.accumulate(cumulative) drawdown = (cumulative - running_max) / running_maxreturn np.min(drawdown) * 100portfolio_max_dd = calculate_max_drawdown(portfolio_values)benchmark_max_dd = calculate_max_drawdown(benchmark_values)# 输出绩效指标print(f"\n📈 总收益:")print(f" DRL投资组合: {portfolio_total_return:.2f}%")print(f" QQQ基准: {benchmark_total_return:.2f}%")print(f" 超额收益: {excess_return:.2f}%")print(f"\n📊 年化收益:")print(f" DRL投资组合: {portfolio_annual_return:.2f}%")print(f" QQQ基准: {benchmark_annual_return:.2f}%")print(f"\n⚖️ 夏普比率:")print(f" DRL投资组合: {portfolio_sharpe:.3f}")print(f" QQQ基准: {benchmark_sharpe:.3f}")print(f"\n⚠️ 最大回撤:")print(f" DRL投资组合: {portfolio_max_dd:.2f}%")print(f" QQQ基准: {benchmark_max_dd:.2f}%")print(f"\n📅 回测期间:")print(f" 开始日期: {price_data.index[0].strftime('%Y-%m-%d')}")print(f" 结束日期: {price_data.index[-1].strftime('%Y-%m-%d')}")print(f" 交易日数: {len(portfolio_values)}天")代码说明:

这个简化版本展示了核心概念:

- 环境设计:我们创建了一个符合OpenAI Gym标准的环境,定义了状态、动作和奖励。

- PPO算法: 使用Stable-Baselines3库的PPO实现,它会自动处理复杂的策略优化。

- 效用函数: 奖励 = 超额收益 – λ × 追踪误差,直接编码在step函数中。

- 回测框架: 训练后在相同数据上测试(实际应该用样本外数据)。

注意事项:

- 这是教学版本,实际应用需要更多数据、更长训练时间和样本外测试;

- 没有包含VAR和异常检测,可以作为进阶练习添加;

- 交易成本、滑点等现实因素也需要考虑。

通过这个代码,你可以:

- 理解DRL如何应用于投资组合优化;

- 修改参数(如λ)观察不同行为;

- 扩展到更多ETF或添加更复杂的特征。

这就是AI投资的魅力:从理论到实践,一步步构建你自己的智能交易系统!

#ETF配置策略 #人工智能投资 #量化研究方法 #纳斯达克100 #资产配置艺术 #风险管理 #投资组合优化 #金融科技前沿

感谢阅读!愿本文为您带来新启发与实用知识。若觉有益,请点赞分享,您的支持是我创作的动力,欢迎留言必复。

风险提示:本文仅供参考,不构成投资建议。量化策略开发应以学习和技术交流为目的。投资有风险,入市需谨慎。

Be First to Comment